Il potere dei

paradigmi:

L’etere

cosmico e la critica di Augusto Righi

all’esperimento

di Michelson-Morley

Pietro Di Mauro, Salvatore Notarrigo, Angelo Pagano

Introduzione

Per molti anni il dibattito e la riflessione

sulla scienza sono stati condizionati dalla “Logica della scoperta scientifica” di sir Karl R. Popper.1

A dire di Popper il suo libro nasceva da una sua contestazione nei confronti di una tesi centrale del neopositivismo logico, secondo la quale solo le affermazioni empiriche e quelle logicamente dimostrabili a partire da esse, sono dotate di significato.

Popper tenta di dimostrare che vi sono affermazioni, che pur non essendo riconducibili alle due possibilità sopra menzionate, hanno significato.

Questo lo porta alla necessità di inventare un “criterio di demarcazione” tra affermazioni scientifiche e pseudoscientifiche. Tale criterio viene identificato con il “criterio di falsificabilità”.

Tale criterio ha molte lacune ed ambiguità, come sottolineato da molti, tuttavia si affermò come essenziale per lo studio della storia delle scienze e, in particolare, della fisica.

La costruzione teorica di Popper, come

espressa nel libro citato, fu interpretata (come lo stesso autore lasciava intendere

fin dal sottotitolo del libro: Il

carattere autocorrettivo della scienza) come una deontologia dello scienziato; anche se gli esempi

storici da lui citati e, naturalmente, dallo stesso reinterpretati potevano

servire a giudicare la sua teoria come adatta a spiegare i fatti concreti della

storia della scienza.

La filosofia popperiana venne rovesciata con

l’apparizione di “La struttura delle

rivoluzioni scientifiche” di Thomas S. Kuhn.2

In tale libro, a partire da una ben altra interpretazione dei fatti della storia delle scienze, si sosteneva la tesi che né la verifica né la falsificazione delle ipotesi scientifiche potevano avere rilevanza per il processo di sviluppo della “scienza normale”, come descritta dallo stesso Kuhn, in quanto questa era esclusivamente guidata dal “paradigma” dominante. Un dato paradigma, secondo tale impostazione, veniva cambiato dopo una lotta tra gruppi rivali di scienziati; se il gruppo sostenitore del nuovo paradigma risultava vincente solo allora si sarebbe avuta una “rivoluzione scientifica”.

Anche qui si hanno molte ambiguità: non è

chiaro quale sia il meccanismo che porta al cambiamento del paradigma, non è

chiaro se la scienza normale sia una necessità logica o un dato di fatto, non è

chiaro il significato stesso di “paradigma”.

Ancora una volta, indipendentemente dalle critiche che ne vennero fatte, il “paradigma” kuhniano si affermò nelle discussioni epistemologiche e nelle analisi di molti storici della scienza, sfociando in discussioni di natura puramente sociologica, che forse erano gli argomenti più adatti per l’interpretazione del significato da attribuire alla nozione di paradigma.

Recentemente la teoria kuhniana è entrata

nella discussione sui problemi dell’insegnamento della fisica.

Schecker3

nota che le difficoltà degli studenti nell’apprendimento della meccanica

newtoniana dipendono dal paradigma che loro deriva dalla “meccanica del senso

comune”, che applicano con successo nella comunicazione quotidiana intorno al

moto e alle forze.

A partire da un test eseguito su 254 studenti

di scuola superiore lo Schecker crede che la sua tesi sia confermata al massimo

grado.

È interessante esaminare tali risultati.

Veniva chiesto agli studenti di commentare la

seguente affermazione:

“Nelle lezioni

di fisica si incontrano spesso ipotesi o esperimenti ideali che ovviamente non

possono essere realizzati in un esperimento effettivo, come, p. es., l’esclusione

della resistenza dell’aria ed altri effetti di attrito o l’ipotesi di un moto lineare che dura

infinitamente.

Pensi che un

tale metodo sia utile o inutile? Fornisci delle ragioni per la tua risposta.”

Solo il 10% ha definito il metodo come senza senso. Ma un’analisi più accurata delle risposte di coloro che consideravano utile il metodo mostrava che solo un terzo di essi aveva dato la risposta che lo sperimentatore riteneva corretta e cioè che i casi ideali sono strumenti mentali per strutturare la realtà sensibile e funzionano come principi di base del processo. Gli altri lo ritenevano positivo solo in quanto rende le cose più facili, oppure per la semplice ragione che non è necessario riferirsi sempre alla realtà quando si è interessati alla fisica.

Noi crediamo che non si sarebbero ottenuti

risultati molto diversi se il test fosse stato eseguito su un campione di

scienziati.

Riprenderemo tali considerazioni

epistemologiche dopo avere illustrato un caso molto significativo che si

riferisce al famoso esperimento di Michelson e Morley.4

Due paradigmi a confronto: campi e particelle

Fin dall’antichità due paradigmi fondamentali

si sono confrontati sul significato da attribuire alla parola “scienza”.

Diogene Laerzio divide i filosofi in due

categorie:5 dogmatici ed efettici.

I primi pensano che qualsiasi discorso sulla

realtà debba partire da proposizioni vere, perché evidenti per il significato

stesso dei termini, che quindi bisogna assumere come assiomi. I secondi pensano che prima di asserire una proposizione

bisogna astenersi da ogni giudizio sulla sua verità e bisogna invece porla

semplicemente come ipotesi da

vagliare.

Ponendo la questione al modo degli efettici,

senza dare alcunché per certo, l’unico modo possibile per avanzare nella

ricerca resterebbe quello proposto dai neopositivisti, contestati da Popper;

o, in ogni caso, bisognerebbe assumere una qualche forma di empirismo, che,

anche assumendo criteri deduttivi, può portare al massimo al metodo ipotetico -

dettuttivo, caldeggiato da Einstein sostenuto, in questo, dal Popper.

Per i dogmatici il problema non si pone,

perché di assolutamente certo vi sono le nostre convenzioni linguistiche,

fondate a partire dalle operazioni fisiche elementari, come, p. es., quelle che

possiamo compiere mediante l’uso di riga e compasso, facilmente controllabili.

Successivamente, Diogene Laerzio introduce

un’altra distinzione tra i filosofi: Italici e Ionici (tale distinzione si deve

fare risalire ad Aristotele).

Bisogna pensare che tale distinzione viene fatta sulla base della precedente distinzione di ordine teoretico, infatti tra gli Italici vengono elencati, oltre ai Pitagorici propriamente detti e agli Eleati (Parmenide e Zenone), anche altri di origine non italica, come Democrito ed Epicuro, e fra gli Ionici, oltre Talete, Anassimandro ed Anassimene, vengono elencati anche Platone ed Aristotele, di origine non ionica.

Strettamente connessa a tali distinzioni ve

n’è un’altra molto importante dal punto di vista della fisica che oggi

chiameremmo l’opposizione tra una teoria di particelle e una teoria di campo.

Per gli Italici l’unico principio, essendo di

natura logica (il “numero” come viene riportato per i Pitagorici dai

dossografi), può essere costituito da un mondo di “particelle”. Infatti, a

partire dall’Essere logico (il Tutto) di Parmenide, contrapposto al Nulla, e

dalla teoria dei contrari dei Pitagorici (le classi complementari della logica

di Peano), si perviene, per successive dicotomizzazioni, all’idea di

particella. Con una prima dicotomizzazione dell’Essere si produce

l’opposizione, puramente logica: “enti che hanno estensione” ed “enti che non

hanno estensione”. Con una seconda dicotomizzazione degli enti estesi, si

perviene agli enti materiali (gli “atomi” di Democrito, privi di “pori”, ovvero

le particelle, che possono essere piccole o grandi “quando il mondo”, come

ricorda lo stesso Democrito) e agli enti estesi non materiali (i punti

geometrici dello spazio vuoto).

Per gli Ionici, invece, l’unico principio,

essendo di natura materiale (come ricorda Aristotele), può essere solo un

“campo” fatto di acqua, o di aria, o di Apeiron, cioè il principio indefinito

di Anassimandro.

Gli Italici replicano che ciò è assurdo

perché senza il vuoto interposto tra le particelle, anche le più piccole, non

può aversi il movimento.

Ma il paradigma del “campo” si impone fino ai

tempi di Galilei, sulla base del dogma empirista, propugnato da Aristotele, che

negava il vuoto, dal momento che non lo possiamo vedere con i nostri sensi.

Come se, d’altra parte, si potessero toccare e vedere gli enti astratti dei

Pitagorici: Terra, Acqua, Aria e Fuoco, ammessi anche da Aristotele, come sostanze, semplicemente

perché possiamo avvertire con i nostri sensi qualcosa di concreto che chiamiamo

con lo stesso nome, scritto con l’iniziale minuscola.

Il paradigma delle particelle viene ripreso da Galilei e si afferma presso la gran parte degli scienziati mediante la teoria matematica di Newton, almeno per quanto riguarda le forze gravitazionali. Tuttavia il paradigma del campo resiste ancora per quanto riguarda la luce, che viene pensata come dovuta alle oscillazioni dell’“etere cosmico” che pervade tutto l’universo, etere che è un mezzo materiale con ben strane proprietà. E tale concezione, con qualche modificazione introdotta dalla relatività e dalla meccanica quantistica, ancora permane presso la maggior parte dei fisici odierni.

Per vedere ciò riportiamo qualche brano dalla

prefazione di una prestigiosa opera di storia dell’elettromagnetismo:6

“Una parola è

necessaria sul titolo “Etere ed elettricità”. Come si sa, l’etere ha giocato un

grande ruolo nella fisica del secolo diciannovesimo; ma nella prima decade del secolo

ventesimo, principalmente come risultato del fallimento del tentativo di

osservare il moto della terra relativo all’etere e dell’accettazione del

principio che tali tentativi debbano sempre fallire, la parola “etere” perse favore e divenne di moda riferirsi agli spazi interplanetari con il termine “vuoto”; il vuoto viene concepito come mera mancanza di

qualsiasi cosa, senza alcuna proprietà tranne quella della propagazione delle

onde elettromagnetiche. Ma con lo sviluppo dell’elettrodinamica quantistica, il

vuoto è stato considerato come la sede delle oscillazioni di “punto zero” del

campo elettromagnetico, delle fluttuazioni di “punto zero” di cariche e

correnti elettriche, e di una “polarizzazione” corrispondente alla costante

dielettrica diversa dall’unità. Sembra assurdo mantenere il nome di “vuoto” a

un’entità così ricca di proprietà fisiche, e la storica parola

“etere” può essere mantenuta.”

La ragione di ciò sta nella difficoltà che si

incontra, entro un paradigma empirista, incapace di allontanarsi dal dato

immediato dei sensi, di poter concepire qualsiasi azione a distanza,7 anche a costo di introdurre

enti non visibili, ma comunque sempre materiali.8

Secondo il Whittaker, il paradigma delle

particelle, anche in relazione ai fenomeni luminosi, viene sostenuto, per primo

dal Gassendi.9

Il Whittaker sostiene, contrariamente ai

molti che ancora oggi attribuiscono a Newton la concezione della luce fatta da

corpuscoli in movimento, che questi non prende posizione a proposito della

costituzione della luce. Ma noi pensiamo che Newton ha in mente già

l’interazione a distanza (cosa che poi avrà il coraggio di proporre nei suoi

‘Principia” (1687) per quanto riguarda l’attrazione gravitazionale), infatti

in un suo manoscritto - inteso a spiegare, contro coloro che l’accusavano di

abbandonare la filosofia meccanicistica, il perché in una memoria presentata

nel 1672 alla Royal Society aveva affermato che “non si disputerà più a lungo se ... e nemmeno, forse, se la luce è un corpo.” - spiega:10

“A causa di

una distinzione impropria fatta da alcuni in ordine alle ipotesi meccaniche,

ossia tra quelle per le quali la luce è considerata un corpo e quelle per le quali è considerata

l’azione di un corpo — intendendo la prima corpi

proiettati attraverso un mezzo, la seconda moti o pressioni propagati attraverso di esso — questa posizione può sconsideratamente essere intesa come appartenente

alla prima; ma in entrambi i casi la

luce è ugualmente un corpo o l’azione di un corpo. Se, nel primo caso, i raggi

di essa vengono chiamati corpi proiettati, allora, nell’altro caso, i raggi

sono corpi che propagano il moto

dall’uno all’altro in linee rette, finché

l’ultimo colpisce il senso. L’unica differenza è che nell’un caso un raggio è

nient’altro che un corpo, nell’altro molti. Analogamente, se nell’ultimo caso

il moto propagato attraverso i corpi viene chiamato raggio, nel primo sarà moto

continuato nei medesimi corpi. In tutt’e due i casi, però, i corpi devono causare la visione per effetto

del loro moto. Ora, essendo mia intenzione, in questo luogo, soffermarmi sui

concetti dei peripatetici, ho assunto il corpo non in opposizione al moto, come

nella distinzione detta, bensì in opposizione alla qualità peripatetica,

dirimendo la controversia tra

la filosofia peripatetica e quella

meccanica con l’indagare se la luce è una qualità o un corpo. Che la mia idea

fosse questa, appare dal mio congiungere questa controversia con altre

controversie fin qui dibattute tra le due filosofie, sia utilizzando

relativamente all’una i termini

peripatetici qualità, soggetto, sostanza, qualità sensibili, sia, rispetto

all’altra, i termini meccanici corpo, modi, azioni, sia, infine, lasciando

indeterminato il genere di quelle azioni (se pressioni, urti o altro) per

effetto delle quali la luce può produrre nelle nostre menti i fantasmi dei colori.”

In altre parole tutto, compresa la luce, è materia e movimento, come per i Pitagorici,

quindi, usando il vocabolario dei peripatetici, la luce dovrebbe chiamarsi sostanza e non qualità, che è solo l’apparenza sensibile che la sostanza produce

nei nostri sensi, come aveva specificato nella sua memoria presentata alla

Royal Society. Newton, come scrive ad Oldenburg, accetta l’idea di Hooke del

moto vibratorio causato dalla luce, ma essa non puo consistere solo in ciò,

che è solo quello che possiamo avvertire con gli esperimenti, ma deve essere

qualcosa d’altro, e certamente non è una qualità peripatetica, forse è più

vicina al concetto democriteo di coesione tra atomi in moto relativo tra loro,

l’azione a distanza. Nel seguito molti accettarono pienamente l’idea

dell’azione a distanza come Boskovich, Ampere e molti altri.

I due paradigmi per lungo tempo stanno testa

a testa: da un lato i sostenitori dell’etere, dall’altro i sostenitori

dell’azione a distanza.

Questa situazione ce la ritroviamo fino ai

tempi di Maxwell.

Infatti scrive Maxwell, nella prefazione al

suo famoso “Trattato”:11

“Il trattato

nel suo complesso differisce considerevolmente da altri eccellenti lavori di

elettricità pubblicati, per la maggior parte in Germania, e potrà sembrare che

vi venga resa scarsa giustizia al pensiero di parecchi eminenti cultori di

elettricità e matematici. Una delle ragioni di ciò è che, prima di cominciare a studiare

l’elettricità, avevo deciso di non leggere sull’argomento nessuna trattazione

matematica, se non dopo avere letto interamente le Ricerche sperimentali di

Faraday. Sapevo che si riteneva esserci una differenza tra il modo di

concepire i fenomeni proprio di Faraday e quello dei matematici, cosicché né il

primo né i secondi erano soddisfatti del reciproco linguaggio usato. Ero anche

convinto che la discrepanza non sorgesse dal fatto che l’una o l’altra delle

due parti fosse in errore. Il primo a persuadermi di questo fu Sir William

Thomson, ai consigli e all’assistenza del quale, così come ai suoi lavori pubblicati, io devo la maggior parte di quanto ho

imparato sull’argomento. ...

Quando ebbi

tradotto quelle che consideravo le idee di Faraday in forma matematica, trovai

che in generale i risultati dei

due metodi coincidevano, così che con entrambi si potevano spiegare gli stessi fenomeni e dedurre le

stesse leggi di azione; mentre però i metodi di Faraday assomigliavano a quelli

un cui si comincia da un tutto per arrivare alle parti per via analitica, gli

ordinari metodi matematici si basavano sul principio di cominciare dalle parti

per arrivare al tutto per via di sintesi. ...

Un grande

progresso nella scienza elettrica è stato compiuto, sopra tutto in Germania, da

parte di cultori della teoria dell’azione a distanza. Le preziose misurazioni

elettriche di W. Weber sono state interpretate da lui stesso secondo questa

teoria e la teorizzazione sull’elettromagnetismo originata da Gauss, e portata

avanti da Weber, Riemann, J. e C. Neumann, Lorenz, ecc., si basa sulla teoria

dell’azione a distanza; essa

dipende, però, o direttamente dalla velocità relativa delle particelle, oppure

dalla propagazione graduale di un qualche cosa, sia esso potenziale o forza, da una

particella all’altra. Il grande successo ottenuto da questi uomini eminenti

applicando la matematica ai fenomeni elettrici conferisce, come è naturale,

ulteriore peso alle loro ricerche teoriche, cosicché coloro che, nello studio

dell’elettricità, si rifanno a loro

come alle più grandi autorità in fatto di teoria matematica dell’elettricità,

probabilmente finiranno con l’assorbire, assieme ai loro metodi, anche le loro

ipotesi fisiche.

Queste ipotesi

fisiche, però, rimangono completamente al di fuori del mio modo di guardare

alle cose, e uno degli scopi che mi propongo è che alcuni di coloro che

vogliono studiare l’elettricità possano, leggendo questo trattato, rendersi

conto che può esserci anche un altro modo di trattare la materia, modo non meno

adatto a spiegare i fenomeni, e

sebbene in alcune parti possa sembrare meno definito, esso, a mio avviso, corrisponde più

fedelmente allo stato effettivo della nostra conoscenza, sia in ciò

che afferma, sia in ciò che lascia indeciso.

Da un punto di

vista filosofico, inoltre, è estremamente importante mettere a paragone due

metodi, quando entrambi sono riusciti a spiegare i più importanti fenomeni

elettromagnetici ed hanno tentato di spiegare la propagazione della luce come

fenomeno elettromagnetico, riuscendo, effettivamente, a calcolarne la velocità mentre le concezioni fondamentali circa cio che

effettivamente avviene, assieme alla maggior parte dei concetti secondari

riguardanti le quantità in gioco, sono radicalmente differenti.

Perciò, io ho

assunto la parte dell’avvocato, piuttosto che quella del giudice, ed ho

esemplificato un metodo, piuttosto che dare una descrizione imparziale di

entrambi. Non ho dubbi che anche il metodo che io ho definito tedesco troverà i

suoi sostenitori e che verrà esposto con capacità

degna della sua ingegnosità. …”

E a pag. 231 del Trattato scrive:

“Le idee che

guidarono Ampère appartengono al sistema che ammette l’azione a distanza, e troveremo che una notevole serie di speculazioni e ricerche

basate su queste idee sono state portate avanti da Gauss, Weber, F. E. Neumann,

Riemann, Betti, C. Neumann, Lorenz e altri, con risultati assai notevoli sia

per la scoperta di nuovi fatti sia per la formazione di una teoria

dell’elettricità.

Le idee che ho

tentato di seguire io, sono quelle dell’azione attraverso un mezzo, che

trasmette da una porzione alla porzione contigua. Queste idee furono molto

usate da Faraday; il loro sviluppo in forma matematica e il confronto dei

risultati con i fatti noti è stato il mio scopo in molti saggi già pubblicati.

Il confronto, da un punto di vista filosofico, dei risultati dei due metodi,

tanto opposti l’uno all’altro nei loro principi di partenza, deve portare a dati validi per lo studio delle

condizioni della speculazione scientifica”.

Quindi Maxwell afferma che tutti i suoi risultati sono già stati trovati sotto il paradigma dell’azione a distanza.

Infatti, già nel 1857, Kirchhoff aveva

trovato, sulla base delle misure di Weber e Kohlrausch, che le onde

elettromagnetiche si propagavano nei cavi con la velocità della luce.

Il paradigma dell’etere è in bilico: Michelson-Morley

Dopo gli esperimenti di Hertz, che

verificarono l’esistenza delle onde elettromagnetiche, quella dell’etere sembrò

definitivamente assodata, sotto l’ipotesi che le onde potessero viaggiare solo

attraverso un mezzo.

Tuttavia altre difficoltà sorgevano: se

l’etere è un mezzo materiale deve, in qualche modo, interagire con la materia

ordinaria. L’interpretazione degli esperimenti in cui si cercava di mettere in

evidenza tale interazione davano risultati contraddittori. Ci si chiedeva se

l’etere era immobile o se, invece, venisse trascinato totalmente o in parte

dalla materia in movimento.

Già Maxwell, in un suo contributo alla voce

“Etere” dell’Enciclopedia Britannica, nell’edizione del 1878, pensava a un

esperimento, anche se lo riteneva praticamente impossibile, che poteva mostrare

la velocità relativa del moto orbitale della terra rispetto all’etere.

Più tardi Michelson costruisce un

inteferometro di grande sensibilità e nel 1881 lo impiega per fare

l’esperimento.

L’idea, apparentemente, è semplice: se

dividiamo un raggio di luce in modo da far viaggiare uno dei due raggi lungo la

direzione del moto della terra e l’altro in direzione ortogonale e, poi,

riflettendoli entrambi, li facciamo ricongiungere, essi interferiranno e si

potrà risalire alla velocità della terra rispetto all’etere osservando lo

spostamento delle frange di interferenza dovuto a tale movimento.

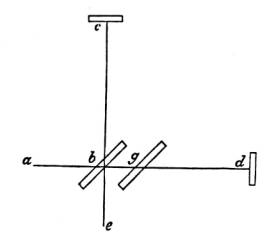

Lo schema dell’esperimento di Michelson è

mostrato in figura.

Un raggio di luce viaggia nella direzione ad, viene diviso da una lamina di vetro,

posta a 45° rispetto alla direzione del raggio incidente, con un sottile

strato d’argento sopra (lamina semiargentata), in modo che il raggio venga in

parte riflesso verso lo specchio in c e

in parte trasmesso verso lo specchio in d.

I raggi riflessi dagli specchi si ricongiungeranno in b e la loro sovrapposizione può essere vista con un piccolo

telescopio in e. La lamina di vetro

in g serve di compensazione, in quanto, senza di essa, un raggio

attraverserebbe due volte la lamina in b (andata

e ritorno) e l’altro, non l’attraverserebbe mai (si suppone che lo strato

d’argento stia nella faccia in basso della lamina).

Se la direzione ad viene fatta coincidere con la direzione del moto della terra e

poi si ruota l’interferometro di 90° si deve osservare uno spostamentento di

frange al telescopio.

Naturalmente, bisognerebbe conoscere la

direzione del moto della terra rispetto all’etere, ma con un po’ di matematica

il problema può facilmente essere superato, confrontando due misure fatte,

l’una in una direzione arbitraria e l’altra con l’intero apparato ruotato di

90°.

Il modello

matematico di Michelson12 prevedeva

una differenza di cammino della luce lungo i due bracci (per il percoso totale

di andata e ritorno) pari a ![]() , dove d è la

lunghezza dei due bracci uguali, v la

velocità della terra rispetto all’etere e c

è la velocità della luce.

, dove d è la

lunghezza dei due bracci uguali, v la

velocità della terra rispetto all’etere e c

è la velocità della luce.

Supponendo che l’etere sia fermo rispetto al

sistema delle stesse fisse, al posto di v

si poteva mettere la velocità orbitale della terra come misurata dagli

astronomi, per d = 1,2 metri, si otteneva, per lo spostamento, ![]() , essendo λ la

lunghezza d’onda della luce gialla del sodio.

, essendo λ la

lunghezza d’onda della luce gialla del sodio.

L’inteferometro di Michelson era in grado di

osservare differenze di cammino, misurando lo spostamento delle frange di

interferenza, molto più piccole di tale valore.

Ma proprio l’alta sensibilità dello strumento

poneva dei seri problemi, in quanto l’apparecchio risultava molto sensibile alle

vibrazioni causate dal traffico cittadino (il primo esperimento fu eseguito

nell’istituto di fisica di Berlino) e, con difficoltà, si poteva lavorare solo

di notte, per cui Michelson pensò di trasferire l’esperimento

nell’osservatorio di Potsdam. Ma anche qui i problemi dovuti alle vibrazioni

erano notevoli ed inoltre Michelson scoperse che l’apparecchio era sensibile a

lievi differenze di temperatura tra i due bracci, causate dalla rotazione

dell’apparato nelle due misure successive. Una differenza di temperatura di un

centesimo di grado centigrado poteva provocare un effetto tre volte maggiore di

quello misurato.

Superando, in qualche modo, tali difficoltà, Michelson riusciva a dare un valore per lo spostamento compreso tra 0.004 e 0,015, cioè un effetto più di cinque volte minore di quello aspettato e concludeva, date le notevoli incertezze delle misure, che l’effetto misurato era, in realtà, da considerarsi nullo e che quindi l’ipotesi di un etere stazionario era da considerarsi erronea. Tuttavia Potier notava un errore nella teoria dell’esperimento: bisognava tenere conto del moto rispetto all’etere anche dello specchio ortogonale alla direzione del moto, cosa che Michelson avveva trascurato. Questo riduceva il valore aspettato a 0,04 , quindi il rapporto tra valore aspettato e valore misurato si riduceva di un fattore due e, data l’incertezza delle misure, non era possibile negare con sicurezza l’ipotesi dell’etere stazionario, come, del resto, si era affrettato a puntualizzare Lorentz, il quale era molto interessato al problema, in quanto la sua teoria dell’elettrone pretendeva un etere stazionario.

In un successivo esperimento, effettuato a

Cleveland (Ohio),13 Michelson

e Morley, riconoscono la validità dell’osservazione di Potier e correggono conseguentemente

la teoria dell’esperimento, inoltre pongono l’apparato su una base massiccia,

galleggiante su una vasca di mercurio, per ridurre l’effetto delle vibrazioni

dovute a cause esterne (così riducendo anche le fluttuazioni di temperatura

provocate dalla rotazione di 90° dei pesanti bracci), portano a 11 metri la

lunghezza dei bracci e migliorano la sensibilità dello strumento facendo

effettuare ai raggi di luce riflessioni multiple per mezzo di appositi specchi

opportunamente sistemati.

Notano che i due raggi di ritorno, secondo la

teoria corretta da quell’errore messo in evidenza da Potier, non si incontrano

nello stesso punto, ma decidono (non si sa su quale base) che tale fatto non

può avere influenza sul risultato dell’esperimento.

Notano che assumere l’etere in quiete

rispetto al sistema solare non ha senso e programmano di ripetere ogni tre mesi

l’esperimento per accertare la possibile esistenza di un moto del sistema

solare rispetto all’etere, cosa che, come vedremo, sarà successivamente

continuata da Miller.14

Ma cosa più importante, in un “supplemento”

in calce all’articolo, notano (sembra su suggerimento di Lorentz) che la legge

di riflessione in uno specchio in moto può essere diversa da quella da loro

usata, e calcolano la correzione da apportare alla teoria, ma si riservano di

accertare tale fatto in un futuro esperimento, da fare sul picco di una

montagna, ideato per verificare l’ipotesi di un eventuale trascinamento

dell’etere da parte della terra.

Questa correzione da introdurre nella teoria è cruciale per il risultato dell’esperimento come dimostrerà Righi.

Il risultato dell’esperimento fornisce un

valore dello spostamento di 0,01, contro un valore calcolato di 0,4.

Sulla base di tale risultato, interpretato

come “risultato nullo di un esperimento cruciale”, cioè come se fosse stato

trovato ![]() , Lorentz è costretto a modificare la sua teoria e, pur di

non abbandonare l’etere stazionario, è costretto a supporre una contrazione dei

corpi lungo la direzione del moto (già ipotizzata dal FitzGerald) sulla base

delle trasformazioni oggi dette “di Lorentz” ma che erano già state studiate

dal Voigt, come riconosce lo stesso Lorentz, sul postulato che sono le sole trasformazioni

che lasciano invariata la relazione r2

- c2t2=

0 o, come già

trovato da Voigt, l’equazione dell’onda.

, Lorentz è costretto a modificare la sua teoria e, pur di

non abbandonare l’etere stazionario, è costretto a supporre una contrazione dei

corpi lungo la direzione del moto (già ipotizzata dal FitzGerald) sulla base

delle trasformazioni oggi dette “di Lorentz” ma che erano già state studiate

dal Voigt, come riconosce lo stesso Lorentz, sul postulato che sono le sole trasformazioni

che lasciano invariata la relazione r2

- c2t2=

0 o, come già

trovato da Voigt, l’equazione dell’onda.

È vero che le trasformazioni di Lorentz

lasciano invariate le cose dette, ma tuttavia non sono le sole, in quanto vi

sono altre trasformazioni lineari e non lineari che fanno la stessa cosa, come

si può facilmente verificare, anche se sono le sole che lasciano invariante

l’espressione ds2 = dr2 - c2dt2,

cosa ben diversa dalla relazione ds2

= 0, condizione

sufficiente allo scopo.

È importante, per capire appieno la vicenda

che si sviluppò intorno all’interpretazione del risultato dell’esperimento di

Michelson e Morley, analizzare più attentamente la filosofia del Lorentz, in

quanto, a quei tempi, egli era uno degli scienziati più accreditati e influenti.

Egli parte dalla teoria di Maxwell, ma ne

modifica sostanzialmente la base interpretativa: da teoria macroscopica e

fenomenologica essa diventa nelle sue mani una teoria microscopica e

fondamentale.

Traduciamo dalla sua “Teoria degli elettroni”

(pag. 1 e 2):15

“Per quanto

concerne la sua base fisica, la teoria degli elettroni nasce dalla teoria

generale dell’elettricità, alla quale resteranno per sempre attaccati i nomi di Faraday e Maxwell.

Voi tutti conoscete

questa teoria di Maxwell, che noi chiameremo la teoria generale del campo

elettromagnetico, e nella quale si tiene costantemente in vista lo stato della

materia o il mezzo occupato dal campo. Io devo subito richiamare la vostra

attenzione sul fatto curioso che, mentre si parla di tale stato, nonostante noi

non lo perdiamo mai di vista, noi non abbiamo bisogno in alcun modo di andare

così lontano da tentare di formarci un’immagine di esso e, infatti, noi non

siamo in grado di dire molto su di esso. È vero che noi possiamo rappresentare

a noi stessi gli sforzi interni che esistono nel mezzo che circonda un corpo

elettrificato o un magnete, che noi possiamo pensare all’elettricità come a una

qualche sostanza o a un fluido, libero di muoversi in un conduttore o legato in

posizioni di equilibrio in un dielettrico, e che, ancora, possiamo concepire un

campo magnetico come la sede di certi movimenti invisibili, come, per esempio,

rotazioni intorno alle linee di forza. Tutto questo è stato fatto da molti fisici

e lo stesso Maxwell ne ha dato

l’esempio. Tuttavia questo non è da considerarsi come realmente necessario; noi

possiamo sviluppare la teoria in larga parte, e possiamo elucidare un gran

numero di fenomeni senza entrare in speculazioni di questo genere. In vero, a

causa delle difficoltà in cui esse ci conducono vi è stata, negli ultimi anni,

la tendenza a evitarle completamente e a costruire la teoria su poche

assunzioni di natura più generale.

La prima di

queste è che in un campo elettrico si ha un certo stato di cose che origina una

forza che agisce su un corpo elettrificato e che, quindi, può essere

rappresentato simbolicamente dalla forza per unità di carica che agisce su tale

corpo. Esso è quello che noi chiamiamo forza elettrica, un simbolo per uno

stato del mezzo sulla cui natura non ci avventuriamo a dire altro.

La seconda

assunzione riguarda il campo magnetico. Senza pensare alle sottostanti rotazioni, di cui

abbiamo prima detto, noi possiamo definirlo mediante la forza magnetica, cioè

la forza per unità di intensità agente su un polo.

Dopo avere introdotto queste due quantità fondamentali, noi tenteremo di esprimere le loro mutue connessioni con un insieme di equazioni che saranno poi applicate a una larga varietà di fenomeni. Le relazioni matematiche vengono quindi ad assumere un posto preminente, per cui Hertz ha potuto persino dire che, dopo tutto, la teoria di Maxwell può meglio definirsi come il sistema delle equazioni di Maxwell”.

Quindi l’idea di “campo” e con essa quella di

“etere” può restare anche se noi non sappiamo che cosa esso effettivamente

rappresenti.

E aggiunge (pag. 8):

“Per di più,

anche se così fosse, questa teoria generale [quella di Maxwell], nella quale noi esprimiamo le proprietà

peculiari dei diversi corpi ponderabili, semplicemente coll’ascri vere a

ciascuno di essi particolari valori della costante dielettrica, ε, della

conduttività, σ e della permeabilità magnetica, μ, non può più essere

considerata soddisfacente se vogliamo ottenere una visione che

penetri più profondamente dentro la natura dei fenomeni. Se noi vogliamo capire

il modo in cui le proprietà elettriche e magnetiche dipendano dalla

temperatura, dalla densità, dalla costituzione chimica o dallo stato

cristallino delle sostanze, noi non possiamo rimanere soddisfatti dalla

semplice introduzione di tali coefficienti, sperimentalmente determinati, per

ogni singola sostanza; noi saremo obbligati a ricorrere a qualche ipotesi concernente il meccanismo che sta sotto ai

fenomeni.

È da tale

necessità che si è arrivati all’idea degli elettroni, cioè, a particelle

estremamente piccole, elettricamente cariche, che sono presenti in numero

immenso in tutti i corpi ponderabili, tali che attraverso la loro distribuzione

ed i loro movimenti noi tentiamo di spiegare tutti i fenomeni elettrici ed

ottici che non si limitino all’etere libero.”

Dopo avere dato uno sguardo ai fenomeni in

cui è necessario fare intervenire il concetto di elettrone, Lorentz continua

(pag. 10):

“Questo rapido

sguardo sarà sufficiente a mostrarvi che la teoria degli

elettroni deve essere riguardata come un’estensione al dominio dell’elettricità

delle teorie molecolari ed atomiche che

sono risultate valide in molte branche della fisica e della chimica. Come è

capitato con queste è probabile che la nostra teoria possa venire considerata

sfavorevolmente da alcuni fisici, i quali preferiscono inoltrarsi, anche in

regioni nuove ed inesplorate, seguendo le grandi e diritte vie della scienza

come noi le possediamo nelle leggi della termodinamica, o che arrivano a

importanti e bellissimi risultati col descrivere semplicemente i fenomeni e le

loro mutue relazioni per mezzo di un conveniente sistema di equazioni. ...”

Dopo avere con degli esempi giustificato il

suo procedimento prosegue col dare alcuni schiarimenti sulla sua teoria:

“Per prima

cosa noi attribuiremo a ciascun elettrone dimensioni finite, comunque piccole

esse possano essere, e fisseremo la nostra attenzione non solamente sul campo

esterno ma anche nello spazio interno, nel quale supporremo che vi sia

sufficiente luogo per molti elementi di volume e in cui lo stato delle cose

possa variare da punto a punto. Per quanto riguarda tale stato supporremo che

esso sia dello stesso genere dei punti esterni. Invero, una delle più importanti tra le nostre

assunzioni fondamentali deve essere quella che l’etere occupa non solo tutto lo

spazio tra molecole o atomi o elettroni ma deve pervadere tutte queste

particelle. Noi aggiungeremo l’ipotesi, che sebbene le particelle possano muoversi,

l’etere rimanga sempre a riposo. Noi possiamo riconciliarci con questa, che a

prima vista può sembrare una idea sconvolgente, col pensare che le particelle

di materia non siano altro che modificazioni locali nello stato dell’etere.

Tali modificazioni possono ben viaggiare in avanti mentre gli elementi di

volume del mezzo in cui esistono rimane a riposo”.

Con questo paradigma resterebbe da spiegare:

a) come parti dell’etere si possano muovere senza influenzare il restante

etere, b) come cariche dello stesso segno possano stare assieme per costituire

l’“elettrone” e vincere le naturali forze repulsive; tentativi fatti da

successivi autori di introdurre un “collante” non hanno avuto molto successo,

in quanto portano ad altri più gravi inconvenienti.

Ancora oggi quest’ultima questione non è

stata superata ma viene nascosta all’interno delle teorie quanto -

relativistiche di campo insieme alle loro, certamente non minori, difficoltà.

Ma di questo tutti sanno.

Continuiamo invece a esporre le idee di

Lorentz con le sue stesse parole (pag. 11):

“Ora, se

dentro l’elettrone vi è dell’etere, vi deve essere anche un campo

elettromagnetico, e per far questo noi dobbiamo stabilire un sistema di equazioni

che possano applicarsi sia a quelle

parti dell’etere dove vi è una carica elettrica, cioè agli elettroni, sia a

quelle dove non ve ne sono. Per quanto riguarda la distribuzione di carica noi

siamo liberi di fare qualsiasi ipotesi ci piaccia. Per convenienza supporremo

che essa sia distribuita in un certo spazio, ad esempio nell’intero volume

occupato dall’elettrone, e considereremo la densità volumica, ρ, come una

funzione continua delle coordinate, cosicché la particella carica viene ad

essere senza netti confini, ma viene ad essere circondata da un sottile strato

in cui la densità decresce gradualmente dal suo valore entro l’elettrone fino a 0. Grazie a questa ipotesi di

continuità per la ρ, che noi estenderemo a tutte le altre quantità che

appaiono nelle nostre equazioni, noi non avremo modo di preoccuparci circa le

superfici di discontinuità, né saremo costretti a riempire la nostra teoria con

innumerevoli equazioni per esse. Inoltre, se supporremo che la differenza tra

l’etere entro e fuori gli elettroni sia causata, almeno nei limiti che ci

interessa considerare, solamente dall’esistenza della densità volumica

nell’interno, si avrà che le equazioni per il campo esterno potranno essere

ottenute da quelle interne semplicemente ponendo ρ = 0, cosicché noi dovremo scrivere un solo

sistema di equazioni differenziali”.

Difficile dire in che senso le equazioni

scritte da Lorentz si possano chiamare, oggi, “microscopiche”.

Da questo si vede, che quando Einstein deriva le trasformazioni di “Voigt - Lorentz” da ipotesi che non implicano una contrazione “materiale” dei regoli, egli accetta facilmente la nuova teoria e non ha nessuna remora ad abbandonare l’“etere”, finché rimane il “campo”. Del resto, come abbiamo sopra visto, Whittaker nota che ribattezzare “vuoto” quello che prima si chiamava “etere”, è solo una questione puramente linguistica!

L’esperimento “cruciale” è irrilevante ma

nessuno se ne accorge:

le analisi di Righi e gli esperimenti di

Miller

Dieci anni dopo la pubblicazione del

risultato di Michelson - Morley, Sutherland16 riprende la teoria dell’esperimento.

Egli nota che, secondo la teoria di Michelson

e Morley, quando si fosse incluso il termine di ordine superiore di cui si

parla nel supplemento al loro articolo, ma da essi trascurato nell’analisi del

risultato, si otterrebbe un risultato nullo, anzi nemmeno sarebbe stato

possibile vedere le frange di interferenza: le frange si vedono solo a causa

di un leggero disallineamento della geometria che porta ad osservare soltanto

una frazione dello spostamento massimo, che si sarebbe potuto osservare con un

disallineamento calcolato, diverso da quello ottenuto con l’aggiustamento

manuale dell’apparato, al solo scopo di osservare le frange, operazione

necessaria prima di qualunque misurazione dello spostamento delle medesime. Suggerisce

quindi di ripetere l’esperimento, tenuto conto di questo fatto, in vista di

ottenere la sensibilità massima.

La stessa osservazione viene successivamente

fatta da Hicks,17 il quale

però pone l’accento sulla non coincidenza dei punti in cui i due raggi di

ritorno si incontrano sull’asse ad. Quindi

sviluppa una teoria generale per un sistema con arbitrari orientamenti della

lamina semiargentata e degli specchi.

Hicks va molto oltre, esaminando l’ipotesi

della contrazione supposta da FitzGerald per spiegare il risultato nullo, e

conclude, erroneamente, che per spiegare il risultato nullo occorrerebbe un

allungamento più che una contrazione.

Questa conclusione fu subito contestata e l’errore

riconosciuto dallo stesso Hicks. Tale errore gettò il discredito su tutta la

sua teoria dell’esperimento, che invece era assolutamente indipendente da tale

errore, dovuto a un’applicazione errata delle sue stesse formule, le quali,

del resto, venivano riconosciute corrette da Morley e Miller, che puntualmente

verificano, mediante i dati ricavati dall’esperimento, alcune conclusioni di

tale teoria, ma si affrettarono a far notare che, entro l’approssimazione

supposta (?!), le loro formule erano corrette, non preoccupandosi del fatto che

proprio l’approssimazione era in discussione.

La questione fu ripresa in seguito dal Righi,

il quale si propose di studiare la teoria dell’esperimento usando

esplicitamente e formalmente il principio di Huygens, che nei discorsi

precedenti veniva presupposto, nel vocabolario dei raggi di luce intesi come

abbreviazioni simboliche dei fronti d’onda.

Le conclusioni di Righi sono sconvolgenti ed

è singolare, che nella letteratura sull’argomento, antica e moderna, raramente

viene citato, né per accettare la sua teoria, né per contestarla, nonostante

egli non fosse l’ultimo arrivato sui problemi dell’interferenza di onde

luminose!

D’altra parte sembra inverosimile che i

sostenitori della teoria del campo continuassero a trattare i raggi di luce

come delle particelle trascurando completamente la costruzione di Huygens che

solo giustifica l’uso dei raggi di luce, ma solo come vettore normale ai fronti

d’onda e non come vettore velocità di singole particelle, cosa che lo stesso

Newton, al quale veniva erroneamente attribuita l’idea che la luce fosse

costituita da particelle, non si sarebbe mai sognato di fare!

Ma, accettando l’ipotesi kuhniana sui vari

meccanismi messi in atto dagli scienziati in difesa di un paradigma, a noi

sembra ovvio che la migliore strategia da adottare in caso di difficoltà è

quella di ignorare il problema. Ma vediamo quale è il problema posto dal Righi.

Egli fa una rapida analisi delle teorie

precedenti sull’apparato sperimentale, comprese quelle di Sutherland e di

Hicks, e decide che il miglior modo di affrontare il problema è quello di

attenersi strettamente all’uso del principio di Huygens, e scrive: “la validità di tutto quanto sarà esposto è

subordinata alla validità di detto principio”.18

Quindi nota che un raggio di luce, che

procede parallelamente a un raggio dato, incide sulla lamina semiargentata,

posta a 45°, con un ritardo o un anticipo rispetto al raggio dato, a seconda che

la proiezione del suo punto di incidenza su una retta ortogonale alla direzione

del moto della lamina e giacente nel piano del foglio, nel disegno più sopra

riprodotto, stia sopra o sotto la proiezione del punto di incidenza del raggio

dato.

Questo fatto comporta che le due immagini

della sorgente luminosa, generate dai due fasci di luce paralleli, che si

originano dalla lamina semiargentata, quando di nuovo si sovrappongono, non

staranno su piani paralleli, come viene supposto nell’approssimazione usata da

Michelson e Morley per analizzare i dati.

Quando si tenga conto di tale importante

fatto si trova che, nell’allineamento presupposto nel modello di Michelson e

Morley, lo spostamento delle frange, calcolato per una rotazione di 90°, deve

essere esattamente nullo.

Solo disallineando almeno uno dei tre

riflettori si può avere uno spostamento diverso da zero e, comunque, molto più

piccolo di quello calcolato con la teoria di Michelson e Morley.

Nella seconda, delle quattro memorie di cui

alla nota precedente, trova, in un’approssimazione migliore di quella di

Michelson e Morley, corrispondente al termine da essi trascurato nell’analisi

dei dati ma dai medesimi calcolato nel supplemento al loro articolo, le formule

per lo spostamento delle frange, per effetto della rotazione di 90°, valide per

valori arbitrari degli angoli di riflessione dei tre riflettori.

Nella terza memoria calcola numericamente il

valore dello spostamento delle frange per piccoli valori del disallineamento,

vicini a quelli che probabilmente gli sperimentatori realizzavano con

l’aggiustamento manuale effettuato per rendere visibili le frange, che,

altrimenti, sarebbero risultati invisibili.

Questo comporta che, anche se piccolo, uno

spostamento si deve avere, per cui nella quarta memoria propone un piano di

esperimenti inteso a verificare la nuova ipotesi, che nel frattempo era stata

avanzata, la quale spiegava il risultato nullo dell’esperimento sulla base

della relatività di Einstein.

Infatti, ai tempi di Righi, il risultato

dell’esperimento aveva cambiato scopo e non era più inteso a verificare il moto

relativo tra terra ed etere ma a confermare o refutare la teoria della

relatività.

Infatti, nella prima memoria Righi affermava:

“Evidentemente,

se questo si fosse saputo prima del 1887 non si sarebbe forse ideata

l’esperienza di Michelson, per cui sarebbe probabilmente mancata l’occasione

di pensare alla relatività e alla contrazione.”

E più oltre, dato il risultato, supposto

nullo, dell’esperienza di Michelson e Morley:

“La mia teoria

fa prevedere che la stessa esperienza di Michelson potrà mostrare cambiamenti

colla rotazione di 90° se i

riflettori sono spostati angolarmente dalle loro orientazioni presupposte.

Sarebbe opportuno esaminare, calcolando tali cambiamenti, se siano di tale

grandezza da poterne constatare la produzione o la loro mancanza. Non è dunque

il caso di asserire che la Teoria della Relatività rimanga priva di base

sperimentale.” (Si deve naturalmente intendere fino a quando non si fossero eseguiti

esperimenti come quelli da lui proposti nella quarta memoria).

Qualche anno dopo lo studio del Righi viene

ripreso da un altro fisico italiano.

Il Valle19

nota che nella teoria del Righi viene trascurata l’aberrazione che

subirebbe il fascio di luce incidente per andare dalla sorgente luminosa alla

lente che rende parallelo il fascio stesso e completa in questo senso la teoria

del Righi.

Anche con tale correzione aggiuntiva

l’esperimento, come congegnato dal Michelson, prevede un effetto nullo come

calcolato dal Righi e uno spostamento può solo verificarsi per il

disallineamento di uno specchio; tuttavia se si fa l’ipotesi che l’angolo di

cui si deve disallineare lo specchio normale alla direzione della luce sia

dello stesso ordine di grandezza del rapporto tra la velocità della terra e la

velocità della luce si riottiene il risultato preventivato dal Michelson.

Ovviamente tale ultima considerazione è del

tutto irrilevante allo scopo di salvare il “risultato nullo”, in quanto solo

per puro caso gli sperimentatori possono avere imbroccato l’angolo giusto non

avendolo considerato nella loro teoria dell’esperimento (per non dire

dell’estrema piccolezza di tale angolo), e, soprattutto, per il fatto che

nessuna ragione a priori ci permette di asserire che il sistema solare sia in

quiete rispetto all’etere.

Né, d’altra parte, l’aberrazione dovuta alla

lente posta davanti alla sorgente luminosa può essere d’aiuto per una misura

assoluta della velocità della terra rispetto all’etere, date le enormi incertezze

che l’analisi completa dell’esperimento fa prevedere.

L’unica possibilità è quella di tentare degli

esperimenti che, sfruttando lo spostamento di frange con specchi disallineati,

riesca a individuare almeno la direzione del moto.

Esperimenti di questo tipo furono effettuati

da Miller, il quale, come e molto probabile, studiò attentamente i lavori di

Righi.20

Miller, nell’articolo citato alla precedente

nota, fa una piccola storia dei vari esperimenti, a partire da quello originale

di Michelson del 1881 ed è molto polemico su quelli che asseriscono essere

stato nullo il risultato degli esperimenti di Michelson:

“Tuttavia, e

questo fatto deve essere enfatizzato, l’effetto indicato non era nullo; la

sensibilità dell’apparato era tale che la conclusione, pubblicata nel 1887,

stabiliva che il moto relativo, tra

terra ed etere, osservato non eccedeva un quarto della velocità

orbitale della terra. Questo è assolutamente diverso da un effetto nullo così

frequentemente imputato a tale

esperimento dagli scrittori della Relatività. È anche necessario richiamare

l’attenzione su di un altro fatto storico: Michelson e Morley fecero solo una

serie di osservazioni, nel luglio del 1887, e non ripeterono

più l’esperimento sul movimento relativo all’etere in nessun’altra data,

nonostante molte asserzioni contrarie che si trovano sulla carta stampata.”

Egli ricorda anche che Morley e Miller fecero

un esperimento, nel 1902, sostituendo la base d’acciaio dello strumento con una

base di pino bianco, per accertare se l’ipotesi della contrazione di

Lorentz - FitzGerald potesse dipendere dal tipo di materiale, e che

trovarono un piccolo effetto positivo, leggermente maggiore di quello trovato

precedentemente, tale da escludere la ipotizzata dipendenza.

Un nuovo, più perfezionato, apparato fu

costruito nel 1904, con il quale furono fatti i successivi esperimenti.

Esperimenti furono eseguiti nel 1904 e nel

1905 da Morley e Miller, con valori dello spostamento positivi e leggermente maggiori

dei precedenti.

Con l’intervento della teoria della

relatività, che prevedeva uno spostamento nullo, lo scopo dell’esperimento

cambiò. Ora si trattava di verificare se i

risultati diversi da zero erano solo dovuti a fluttuazioni casuali e

incontrollabili o se erano dovuti ad effetti sistematici, che avrebbero potuto

infirmare le ipotesi della teoria della relatività.

Questo significava che, per avere una

risposta sulla nuova questione, un solo esperimento non era più sufficiente, ma

bisognava eseguire tutta una serie di esperimenti spaziati nel tempo, per

accertare eventuali sistematicità che potessero permettere di individuare un

moto assoluto del sistema solare nel sistema delle stelle fisse.

Il termine “etere” non è più necessario per

interpretare il risultato dell’esperimento.

Diverse osservazioni furono compiute col

nuovo apparato sia sul monte Wilson che a Cleveland, negli anni dal 1921 al

1926 da parte di Morley e Miller e successivamente solo da Miller.

Quest’ultimo, nell’articolo citato nella nota

precedente, asserisce che gli scopi degli esperimenti sono cambiati nel corso

del tempo.

Prima del 1925 gli esperimenti erano effettuati per verificare una singola determinata ipotesi: il moto relativo della terra rispetto all’etere, considerato completamente stazionario e quindi non trascinato dal moto della terra, assumendo il sistema solare fermo rispetto all’etere o al più in moto verso la costellazione di Ercole, con una velocità di diciannove chilometri al secondo.

I risultati non si accordavano con tali

ipotesi, ma l’attenzione era quasi totalmente rivolta a questo e nessun

tentativo fu rivolto a determinare il punto esatto verso il quale si dirigeva

il sistema solare (apice).

L’esperimento fu applicato anche a verificare l’ipotesi della contrazione di Lorentz - FitzGerald, ma anche in questo caso la risposta dell’esperimento fu negativa, nel senso che nessuna sensibile differenza si osservava per corpi di diverse proprietà elettriche e magnetiche.

Tuttavia persisteva costantemente, in tutti

gli esperimenti, un piccolo effetto che non era stato spiegato, nonostante si

sostenesse che l’interferometro era perfettamente idoneo a rivelare il moto assoluto della terra e del sistema

solare nello spazio.

Dal 1925 in poi Miller si propose di verificare

l’esistenza di un tale moto assoluto, per far questo occorreva fare diverse

osservazioni in diverse ore del giorno e in diversi mesi dell’anno,

corrispondenti alle diverse posizioni della terra lungo la sua orbita e nel suo

moto di rotazione.

La teoria per la determinazione dell’apice fu fatta da J. J. Nassau e P. M. Morse, pubblicata in Astrophysical Journal, 65, 73(1927).

In base a tale teoria, sulla base di diverse

centinaia di pagine di singole letture della posizione delle frange di tutte le

osservazioni fatte prima del 1925, mediante un’analisi statistica sulle loro

componenti di Fourier (di cui il Miller era un esperto, infatti si era a lungo

occupato di acustica musicale e aveva publicato un libro sull’argomento, al

quale rinviava per una descrizione dei metodi adoperati), egli conclude che “gli esperimenti davano un’evidenza

conclusiva di un effetto reale che era sistematico anche se piccolo in

grandezza”, per cui era necessario riprendere le

osservazioni con lo scopo in vista di accertare tali sistematicità.

Dalle analisi di Sutherland, Hicks e Righi,

noi sappiamo che non è possibile derivare, da una misura degli spostamenti

delle frange, un valore assoluto per la velocità del sistema solare rispetto

allo spazio assoluto, ma è possibile accertare la direzione ed il verso del

vettore velocità.

Miller sa perfettamente questo e fa

riferimento alle formule generali ricavate da Hicks, scrivendo: “Il Prof. W. M. Hicks dell’università di

Sheffield, ha fatto un’elaborata discussione della teoria, usando metodi che

non solo sono rigorosi ma anche generali. Nella teoria di Hicks viene mostrato

che quando si riescono ad osservare variazioni periodiche nelle fasi relative

dei due fasci [di luce], con

gli specchi come aggiustati in pratica, si introduce un effetto addizionale che

ha una periodicità di un intero giro dello strumento.”

Tale effetto è legato alla larghezza delle frange, sfortunatamente in tutti gli esperimenti non si tenne conto di questo e non si misurò la larghezza delle frange, tuttavia un valore approssimato si è potuto ricavare dal numero delle frange che comparivano nel campo visuale, che era un numero che spesso veniva registrato. Un confronto di tali dati verificava perfettamente la teoria di Hicks.

Miller scrive:

“Questo ci dà

per la prima volta una determinazione quantitativa del moto assoluto del

sistema solare e una rivelazione positiva dell’effetto del moto orbitale della

terra, con l’uso dell’interferometro.”

Il risultato finale è così riassunto:

“La locazione

dell’apice così determinata è nella costellazione Dorado, Pesce Spada, ed è

circa 20° a sud della stella Canopo, la seconda stella

più brillante nel cielo. È nel mezzo della famosa Grande Nube di Magellano di

stelle. L’apice è solo 7° circa dal polo dell’eclittica e solo 6° circa

dal polo del piano invariante del sistema solare; cosicché il moto indicato del

sistema solare è quasi perpendicolare a

tale piano invariante.”

Possiamo concludere che le osservazioni di

Miller verificano punto per punto le teorie di Sutherland, di Hicks e di Righi.

Vediamo quali conclusioni si possono trarre

da tali teorie, in larga parte confermate da Miller:

1) Nel modello adoperato da Michelson

l’effetto deve essere nullo. Quindi tale modello non è adatto ad accertare

l’esistenza o meno di un moto assoluto e l’“esperimento cruciale” risulta

assolutamente “irrilevante”.

2) Una teoria corretta più generale

dell’esperimento può dare indicazioni sul moto assoluto ma, nonostante la

teoria esistesse, nessuno si è preoccupato di misurare i dati necessari alla

bisogna.

3) Un moto assoluto si vede anche se non si

può determinare interamente il vettore velocità, ma solo la direzione ed il

verso di essa.

Ma poiché nessuno si e occupato seriamente di

questi quattro signori il risultato dell’esperimento è servito solo a

discriminare tra due teorie, meccanica newtoniana e meccanica einsteiniana,

problema che si è sovrapposto a quello originale dell’etere stazionario, che,

per le misure effettuate, dovevano dare esattamente lo stesso risultato. Tutto

questo con buona pace del principio di falsificabilità di Popper!

Un nuovo paradigma si afferma e si rafforza

Miller esplicitamente asserisce che il

risultato di Michelson e Morley del 1887 non è in contrasto con la serie di

tutti gli esperimenti, ma che si inserisce perfettamente in essi. Nota che gli

esperimenti successivamente compiuti da altri autori e che “conducono a risultati che sono generalmente considerati in contrasto

con le conclusioni di questo articolo”, di fatto non possono certamente

dire niente sul moto assoluto per la ragione che in nessuno di tali esperimenti

“le osservazioni sono state di tale

estensione e di tale continuità da determinare l’esatta natura delle variazioni

diuturne e stagionali.”

Egli afferma che nemmeno una maggiore

sensibilità degli strumenti, rispetto a quelli da lui impiegati, potrebbe dire

qualcosa sul problema finché non si rilevino le variazioni sistematiche dovute

alle varie componenti del moto della terra e che, invece, molti esperimenti di

altra natura compiuti dagli astronomi danno indicazione di un moto assoluto del

sistema solare in perfetto accordo con i risultati della sua analisi.

Miller muore nel 1941 dopo decenni di duro

lavoro dedicato al problema del moto assoluto, per via interferometrica, con

grande dedizione e grande onestà intellettuale.

Oggi egli è praticamente sconosciuto:

raramente viene menzionato nei libri di fisica che parlano dell’esperimento di

Michelson e Morley, il suo nome non risulta nell’elenco di “Scienziati e Tecnologi” degli Annali della Scienza e della Tecnica

della Mondadori, lo stesso dicasi per molte enciclopedie di natura più

generale; in qualcuna di queste figura solo come un esperto di acustica

musicale.

Lo stesso dicasi di Sutherland e Hicks. Righi

viene menzionato solo per gli altri notevoli contributi da lui dati ai fenomeni

elettromagnetici.

Tuttavia sembra che nel 1955 si discutesse

ancora sui risultati di Miller, come si ricava da un articolo di alcuni fisici,21inteso a rivedere i calcoli di

Miller.

Essi infatti asseriscono che le deviazioni

dallo zero dello spostamento delle frange non hanno ancora ricevuto

un’interpretazione adeguata e “poiché

l’interesse in esse è continuato” hanno voluto rifare le analisi

statistiche di Miller, approfittando del fatto che avevano a disposizione, a

Cleveland, i quaderni dove, a suo tempo, Miller aveva registrato i dati

dell’esperimento.

A questo punto, qualcuno si potrebbe

chiedere, perché non rifare gli esperimenti di Miller?

La risposta è facile. Tali esperimenti

avevano bisogno di un’alta tecnologia e di una grande pazienza nel raccogliere

i dati. Infatti solo pochissimi si sono cimentati nell’impresa dopo la triade

Michelson, Morley, Miller.

Ma sentiamo cosa scrivono Shankland et al.

nell’Abstract del loro articolo e confrontiamolo con quanto invece scrivono

nel testo.

Nell’Abstract leggiamo (traducendo

dall’inglese):

“Per quasi

trent’anni i

risultati dell’esperimento di Michelson -

Morley ottenuti da Dayton C. Miller sul

monte Wilson sono stati in contrasto con tutte le altre ripetizioni

dell’esperimento. L’interesse nei risultati di Miller è continuato fino ad ora,

e poiché i dati originali sono

disponibili ai presenti autori, ci è sembrato appropriato assoggettare le

osservazioni a una nuova analisi. Viene mostrato che il piccolo spostamento

periodico delle frange trovato da Miller è in parte dovuto a fluttuazioni statistiche nella

lettura della posizione delle frange in un esperimento molto difficile. Il rimanente

effetto sistematico viene ascritto alle condizioni locali di temperatura.”

Dall’analisi deducono, in accordo con le analisi di Miller, che si ha un forte effetto sistematico per quanto riguarda la prima e la seconda armonica, mentre le tre armoniche superiori sono solo di un ordine di grandezza più alte dell’errore standard e che il valor medio è solo un tredicesimo del valore aspettato, con la teoria usuale (ricordiamo che ciò è in accordo con le teorie di Sutherland, Hicks e Righi, che i predetti autori si guardano bene dal menzionare!).

Concludono che non vi è dubbio che le sole

fluttuazioni statistiche non sono sufficienti per spiegare la perodicità dello

spostamento.

Ma scrivono che, poiché non ritengono valida

l’ipotesi del moto cosmico di Miller (non si capisce bene su quali argomenti è

fondata la loro credenza), non si sono imbarcati a rifare l’analisi statistica

su tale base, ma hanno concentrato i loro sforzi su un’interpretazione dei

risultati di Miller basata sull’ipotesi di disturbi locali causati da effetti

meccanici o di temperatura. Tali possibili cause erano state elencate da

Miller, che si era preoccupato di studiare sperimentalmente e accuratamente,

insieme a Morley, tali disturbi prendendo le opportune precauzioni, ma i

predetti autori sulla base della semplice lettura dei dati sembra che siano in

grado di fare meglio degli sperimentatori.

Ma solo “sembra”! Infatti i detti autori

scrivono:

“Nel seguito,

noi interpreteremo gli effetti sistematici su tale base, ma dobbiamo ammettere

che una diretta e generale correlazione fra ampiezza e fase della osservata

seconda armonica da un lato e le condizioni termiche dall’altro non è stata

stabilita. La ragione di tale fallimento sta nell’inerente inadeguatezza, al

nostro scopo, dei dati delle temperature a

noi disponibili.”

Può sembrare incredibile che si possa asserire un’ipotesi sulla base del fatto che non si hanno dati sufficienti per asserirla!

La deontologia popperiana può andare a farsi

benedire!

Nelle conclusioni si enumerano le inferenze

che si possono dedurre dalla spiegazione dei risultati in base all’ipotesi

delle supposte variazioni di temperatura, che, naturalmente, portano a

confermare il tanto decantato risultato nullo dell’esperimento, che secondo

l’interpretazione più comune sarebbe una prova a favore della relatività e

contro ogni ipotesi di moto assoluto. Ma, come abbiamo visto, la teoria di

Righi prevede un risultato nullo per il modello usuale dell’esperimento e,

quindi non può discriminare tra il moto assoluto e la teoria della relatività,

il disallineamento dell’apparato insieme ai risultati di Miller

“falsificherebbero” la relatività. Ma il risultato di Righi non è stato mai

menzionato nemmeno per criticarlo.

Avendo, attraverso l’analisi di questa lunghissima

serie di esperimenti, capito che non si può prestar fede al falsificazionismo

di Popper (qualunque cosa si possa pensare sul caso concreto analizzato, non vi

è dubbio che non si può chiamare “cruciale” un esperimento che pone diversi

punti “cruciali” per la sua comprensione22),

cosa possiamo dire sui “paradigmi” di Kuhn?

Un paradigma per i paradigmi

La Masterman23 riesce a raccogliere, dal libro di Kuhn, da noi

citato a nota 2, ben ventuno significati diversi per il termine “paradigma”;

forse questa ambiguità del termine è la ragione del suo successo, come

generalmente avviene per le opere d’arte: ognuno vi può trovare il suo

significato.

La prima volta che si incontra tale termine

nel libro di Kuhn si può leggere (pag. 10):

“Con tale

termine voglio indicare conquiste scientifiche universalmente riconosciute, le

quali, per un certo periodo, forniscono un modello di problemi e soluzioni

accettabili a coloro che

praticano un certo campo di ricerca.”

Dal momento che Kuhn non ha dato una

definizione di “scienza” dobbiamo dedurre che egli sappia, ma noi no, che cosa

siano le “conquiste scientifiche universalmente riconosciute”.

Ma è proprio il riconoscimento di tali

conquiste come scientifiche che definisce la “scienza”, per chi non li

riconosce come tali, esse non saranno ne “conquiste” né “scientifiche” e per

questa ragione non possono essere “universalmente riconosciute”, a meno di non

cambiare il significato di “universalmente” o quello di “riconosciute”.

Questa banale osservazione comporta che, se i

paradigmi definiscono la scienza, prima dobbiamo formarci un paradigma di

paradigma; ma per questa via, si può arrivare solamente al “tutto può andar

bene” di Feyerabend, che, appunto, è uno dei paradigmi interpretativi del

termine “scienza”.

Su questo punto ha ragione Popper, se non

definiamo il significato del termine “scienza” non possiamo parlare sulla

scienza.

Certamente il significato popperiano di

scienza è tale che non è possibile trovare nessuna linea di demarcazione tra

proposizioni scientifiche e proposizioni non scientifiche, come giustamente fa

notare il Lakatos24, il quale

propone di abbandonare la “falsificabilità dogmatica”.

Se guardiamo ai grandi scienziati antichi di

lingua greca, con l’ausilio della “logica matematica” del Peano, possiamo

accettare una proposta del Lakatos:25

“la verità si propaga solo verso l’alto, la falsità si propaga solo verso

il basso”.

In altre parole, se asseriamo un certo numero

di proposizioni di base, logicamente indipendenti, e, a partire da esse,

formiamo tutte le possibili proposizioni col solo uso della “disgiunzione

inclusiva” e della “negazione”, formeremo un reticolo di inclusioni (secondo la

definizione matematica di reticolo). Se in basso poniamo la proposizione

“assurda”, al primo livello le “proposizioni base” (gli “atomi” del reticolo),

e ai livelli superiori tutte le proposizioni derivate, fino ad arrivare alla

proposizione “banale” che è implicata da ogni proposizione del reticolo, è

chiaro che l’asserzione delle proposizioni di base assicura la verità di tutte

le proposizioni di livello superiore, ma la verità di una proposizione di

livello superiore niente ci può dire sulla verità delle proposizioni di livello

inferiore. Per la falsità il cammino è proprio l’inverso: la falsità di una

proposizione di livello superiore ci assicura la falsità di almeno una delle

proposizioni di base.

Ma, in ogni caso, niente possiamo dire sulla

verità o falsità delle proposizioni di base, con nessuna verifica empirica.

Da questo discende che le proposizioni di

base devono essere vere indipendentemente da qualunque criterio deduttivo. E,

poiché non è possibile dimostrare la coerenza interna di un sistema deduttivo,

bisogna che le proposizioni di base devono avere un modello concreto

direttamante verificabile con semplicissimme operazioni fisiche “elementari”,

gli stessi assiomi della logica devono obbedire a tale criterio. Gli assiomi

della logica di Peano vi obbediscono, gli assiomi delle logiche moderne non vi

obbediscono, perché si pongono uno scopo diverso: o quello di tentare di

simulare l’ambiguo linguaggio naturale, o quello di giustificare i numeri di

Dedekind e di Cantor, che non possono essere giustificati sulla base dei canoni

di Peano.

Come da molti è stato osservato con tali

canoni bisognerebbe buttare a mare gran parte di quello che tradizionalmente si

chiama scienza e, con essa, anche gran parte dei canoni epistemologici moderni,

ecco perché sembra necesssario introdurre il concetto di “paradigma”. Ma

bisognerebbe anche inventare un “paradigma” per l’interpretazione del concetto

di “paradigma”!

NOTE

1 Il libro fu publicato in italiano da Einaudi

nel 1970 ma la prima edizione tedesca risale al 1934 e la prima traduzione

inglese al 1959. TORNA

2 Il libro fu publicato in italiano da Einaudi nel 1969, l’edizione inglese risale al 1962. TORNA

3 Vedi H.

Schecker, The paradigmatic change in

Mechanics: Implications of historical

processes for Physics Education, in Science & Education, vol. 1, No. 1, 1992. TORNA

4 Maggiori dettagli sull’argomento si possono

trovare nella tesi di laurea in fisica di uno degli autori del presente saggio:

Dr. P. Di Mauro, Analisi degli

esperimenti del tipo ‘Michelson e Morley’ e loro

interpretazione, Tesi di laurea, Univ. di Catania, relatori: Prof. S.

Notarrigo, Dr. A. Pagano. TORNA

5 Sembra che tale distinzione sia molto più

antica, infatti si ritrova in Sozionc, maestro di Seneca. TORNA

6 Sir Edmund

Whittaker, A history of the theories of aether and electricity. vol.

I The classical theories. vol. II The

modern theories, Tomash Publ.,

1951. TORNA

7 Citiamo ancora dalle pagg. 5-6 di Whittakcr

(vedi nota precedente), che parlando della filosofia di Cartesio dice: “Ora uno dei problemi della filosofia

naturale era quello di spiegare l’azione trasmessa tra corpi non in contatto

tra di loro, come quella indicata dal comportamento dei magneti o la

connessione tra la posizione della luna, da un lato, e la caduta delle maree, dall’altro. Accettare questi fatti come

dovuti a influenze “occulte” sarebbe stato contrario ai suoi [di Cartesio] principi; ed egli concluse che essi devono

attribuirsi ad agenti dei soli tipi di azione tra corpi che fossero

perfettamente intellegibili, pressione ed urto. Questo implicava che i corpi

possono agire tra loro solo quando essi sono contigui; in altre parole, egli

negava l’azione a distanza; e questo ha, come ulteriore conseguenza, che lo

spazio tra la luna e la terra, e invero l’intero spazio, non può essere vuoto.

Esso è occupato in parte da cose materiali ordinarie, aria ed altri corpi

tangibili; ma gli interstizi fra le particelle di essi, e il totale del

rimanente spazio, deve essere riempito da particelle di un genere molto più

sottile, che premono da ogni parte, o collidono una sull’altra: questo è il

meccanismo introdotto per spiegare tutti gli accadimenti fisici. Lo spazio

così, per Descartes, è un plenum, occupato da un mezzo che sebbene

impercettibile ai sensi, è

capace di trasmettere forza, ed esercita effetti sui corpi materiali immersi in

esso, l’etere, come viene chiamato. Tale parola

(αίθήρ) originariamente significava il cielo azzurro o

gli strati alti dell’aria (in quanto distinti dagli strati bassi a livello

della terra), che gli scrittori latini hanno preso a prestito da quelli greci,

e che, succesivamente, passò a quelli

francesi ed inglesi nel medioevo.” TORNA

8 Citiamo

sempre dal Whittaker a pag. 8: “La

materia, nella filosofia di Cartesio, non è caratterizzata

dall’impenetrabilità, né da qualunque altra proprietà riconoscibile mediante i

sensi, ma semplicemente dall’estensione; l’estensione costituisce la materia, e

la materia costituisce lo spazio. La base di ogni cosa è il primitivo,

elementare, unico tipo di materia, sensa limiti in estensione e infinitamente

divisibile. Nel processo di evoluzione dell’universo si originarono tre forme distinte di questa materia,

corrispondenti rispettivamente alla materia luminosa del sole, la materia

trasparente degli spazi interplanetari, e la materia densa ed opaca della

terra.” Quindi continua a descrivere la forma che le particelle dei tre

tipi devono avere, in modo non dissimile da quello usato dai dossografi per

descrivere le idee degli Ionici. TORNA

9 Citiamo sempre dal Whittaker, dalle pagg. 12,

13: “Gassendi, professore al collegio di Francia

in Parigi, un seguace di Copernico e Galilei, reintrodusse la dottrina degli

antichi atomisti, cioè che l’universo è formato di atomi materiali, eterni ed immutabili, che si muovono nello spazio che, a parte la loro presenza, è vuoto. L’obiezione

più formidabile al nuovo

insegnamento era che nel mondo greco - romano

esso era associato con le vedute morali e teologiche di Epicuro e di Lucrezio. ...

Dopo una dura controversia con Descartes

nel 1641 - 6, egli ebbe un tale

successo che, come vedremo, la sua dottrina fu accettata non molto tempo dopo

da Newton e, infatti, divenne il punto di partenza di

tutta la susseguente filosofia naturale. Un grande vantaggio di essa fu che

poiché lo spazio ora non era pieno non vi era alcuna necessità per le

particelle di muoversi in modo da formare catene chiuse, e si poteva fare a

meno dei vortici di Cartesio. Come dato di fatto la maggior parte degli

sviluppi ulteriori della teoria postulavano un etere (o qualche volta più di

uno) e cosi, in qualche senso,

tornavano all’idea di uno spazio pieno; ma questi eteri erano concepiti come

qualcosa che non offriva resistenza alcuna al moto della materia ordinaria

attraverso di essi, cosicché le particelle materiali potevano essere trattate

come se si trovassero nel vuoto.” TORNA

10 Newton, Scritti

di ottica, a cura di A. Pala, Utet, 1978, pag. 213. Vedi anche Whittaker, op. cit., pag. 19, dove

riferendosi alle posizioni di Newton scrive: “L’intero spazio è permeato da un mezzo elastico o etere, capace di

propagare le vibrazioni allo stesso

modo in cui l’aria propaga le vibrazioni

del suono, ma con velocità molto maggiore.

L’etere pervade i pori di

tutti i corpi materiali ed è la causa della coesione; la sua densità varia da

un corpo ad un altro ed è maggiore negli spazi interplanetari liberi. Non

necessariamente è una singola sostanza uniforme, ma così come l’aria contiene

vapore acqueo, così l’etere può contenere vari “spiriti eterei”, atti a produrre i fenomeni dell’elettricità, del magnetismo e della

gravitazione.

Le vibrazioni

dell’etere non possono, per le ragioni già menzionate, costituire per se stesse

la luce. La luce perciò deve essere “qualcosa di un genere diverso, propagata

dai corpi lucidi. Chi vuole può supporre che essi siano un aggregato di qualità

peripatetiche. Altri supporranno che siano costituiti da corpuscoli

inimmaginabilmente piccoli e veloci di varie dimensioni che originano dai corpi

lucenti a grandi distanze l’uno dall’altro; ma ancora senza un sensibile

intervallo di tempo e continuamente sollecitate in avanti da un principio di

moto, che all’inizio li accelera, finché la resistenza del mezzo etereo

eguaglia la forza di gravità. Ma quelli a cui questo non piace possono supporre

che la luce sia qualche altra emanazione corporea, o qualche impulso di moto di

qualche altro mezzo o spirito etereo diffuso dai corpi principali dell’etere, o

qualunque cosa possano immaginare a tale proposito. Per evitare ogni disputa e

rendere l’ipotesi più generale, lasciamo ad ognuno le sue fantasie (fancy),

solamente, qualunque cosa la luce possa essere, supporrò che essa consista di

raggi che differiscono l’uno dall’altro per circostanze contingenti come grandezza,

forma o vigore”. TORNA

11 J. C. Maxwell, Trattato di elettricità e magnetismo, UTET, 1973, pag. 129 e segg. TORNA

12 A. A. Michelson,

Am. Jou. Sci., 22, 120(1881). TORNA

13 A. A. Michelson,

E. W. Morlcy, Phil. Mag., 24,

449(1987). TORNA

14 D. C. Miller,

Rev. Mod. Phys., 5, 203(1933). TORNA

15 H. A.

Lorentz, The theory of electrons and its applications

to the phenomena of light and radiant

heat, Teubner, 1909. TORNA

16 W. Sutherland, Phil. Mag., 23(1898). TORNA

17 W. M. Hicks, Phil. Mag., 9(1902). TORNA

18 A. Righi, Nuovo Cimento, XVI, 213(1918), XVIII,

91(1919), XIX, 141(1920), XXI, 187(1921). TORNA

19 G. Valle, Nuovo